Von Hype zur Realität

Die erste Welle der KI im DAM war, gelinde gesagt, enthusiastisch. DAM Hersteller überboten sich mit KI-gestützten Funktionen: Auto-Tagging, Objekterkennung, Background Removal, KI basierte On-Brand Bild Generierung, usw. Die Feature-Listen wurden länger, die Demos beeindruckender.

Doch die Realität war etwas differenzierter.

Auto-Tagging erwies sich häufig als inkonsistent. Modelle, die auf allgemeinen Datensätzen trainiert wurden, verstanden markenspezifischen Kontext natürlich nicht. Was sich Anwender erhofft hatten, war ein System, das Bildinhalte wirklich versteht und Assets automatisch den richtigen Strukturknoten im DAM zuordnet. Stattdessen entstanden generische Tag-Listen, die manuell nachbearbeitet werden mussten.

Auch Tools zur Prüfung von „On-Brand“-Konformität vorhandener, oder zur Veröffentlichung geplanter Assets, hatten klare Grenzen. Sie konnten technische Kriterien wie Logo-Platzierung oder Farbverwendung prüfen, aber nicht beurteilen, ob ein Bild kulturell oder regional passend ist. Gleichzeitig warfen KI-generierte Bilder sofort Fragen zu Authentizität und Urheberrecht auf, häufig ohne dass es dafür klare Governance-Richtlinien gab.

Die Frage nach verifizierter Content Provenance (also verifiziertem Ursprung/Herkunft der Inhalte) entwickelte sich zu einem eigenen Themenfeld. Standards wie C2PA (c2pa.org) ermöglichen es, Herkunft und Änderungshistorie von Inhalten nachzuvollziehbar zu machen, funktionieren aber nur, wenn sie entlang der gesamten Wertschöpfungskette unterstützt werden, sprich bei der Contenterstellung und beim Konsumieren der Inhalte. DAM kann hier eine wichtige Rolle spielen, wird das aber erst mit zunehmender Verbreitung dieser Standards vollständig tun.

Dabei liefert KI im DAM-Kontext durchaus echten Mehrwert. Computer-Vision-Aufgaben, wie Smart Cropping, Objekterkennung, Hintergrundentfernung, On-the-fly-Bildtransformation und so weiter, funktionieren sehr gut, sparen spürbar Zeit und damit Kosten. Natural Language Processing für Transkription und Übersetzung ist ausgereift. Automatisch generierte Textbeschreibungen haben sich erheblich weiterentwickelt und sind in der Praxis deutlich nützlicher als reine Keyword-Tags. Diese Funktionen wurden bereits von vielen DAM-Anbietern übernommen und bieten der Nutzerbasis echten Mehrwert.

Die organisatorische Herausforderung war dabei nicht minder schwierig. Unternehmen wurden mit einer Welle experimenteller KI-Funktionen konfrontiert, die auf bestehende DAM-Plattformen aufgesetzt wurden und Erwartungen weckten, die nicht erfüllt werden konnten. Der konstante Strom scheinbarer „Game-Changer“ Updates von Unternehmen wie Anthropic, OpenAI und Google erzeugt Druck von der Führungsebene, KI einzusetzen, was oft zu übereilten Entscheidungen und Frustration führt, gerade dann wenn Implementierungen hinter den Versprechen zurückbleiben. Nun schwingt das Pendel in die andere Richtung: Viele Unternehmen sind zunehmend zögerlich, KI überhaupt einzuführen.medium.com:Why Some Companies Are Hesitant to Use AI: Challenges, Considerations, and the Bigger Picture)

Der richtige Ansatz liegt irgendwo in der Mitte. Erfolgreiche DAM-Strategien haben immer damit begonnen, die tatsächlichen Anforderungen aus User Sicht richtig zu verstehen. Wenn ein Tool ein klar definiertes Problem löst und dabei zufällig KI einsetzt, dann ist das großartig. Wenn nicht, ist es eben nur ein weiteres Tool, mehr nicht.

Agentische KI: Eine neue Anforderung

Die größere Veränderung liegt in der agentischen KI. Dabei handelt es sich um autonome Softwareprozesse, die systemübergreifend agieren und selbstständig Entscheidungen treffen. Aber was hat das mit Digital Asset Management zu tun?

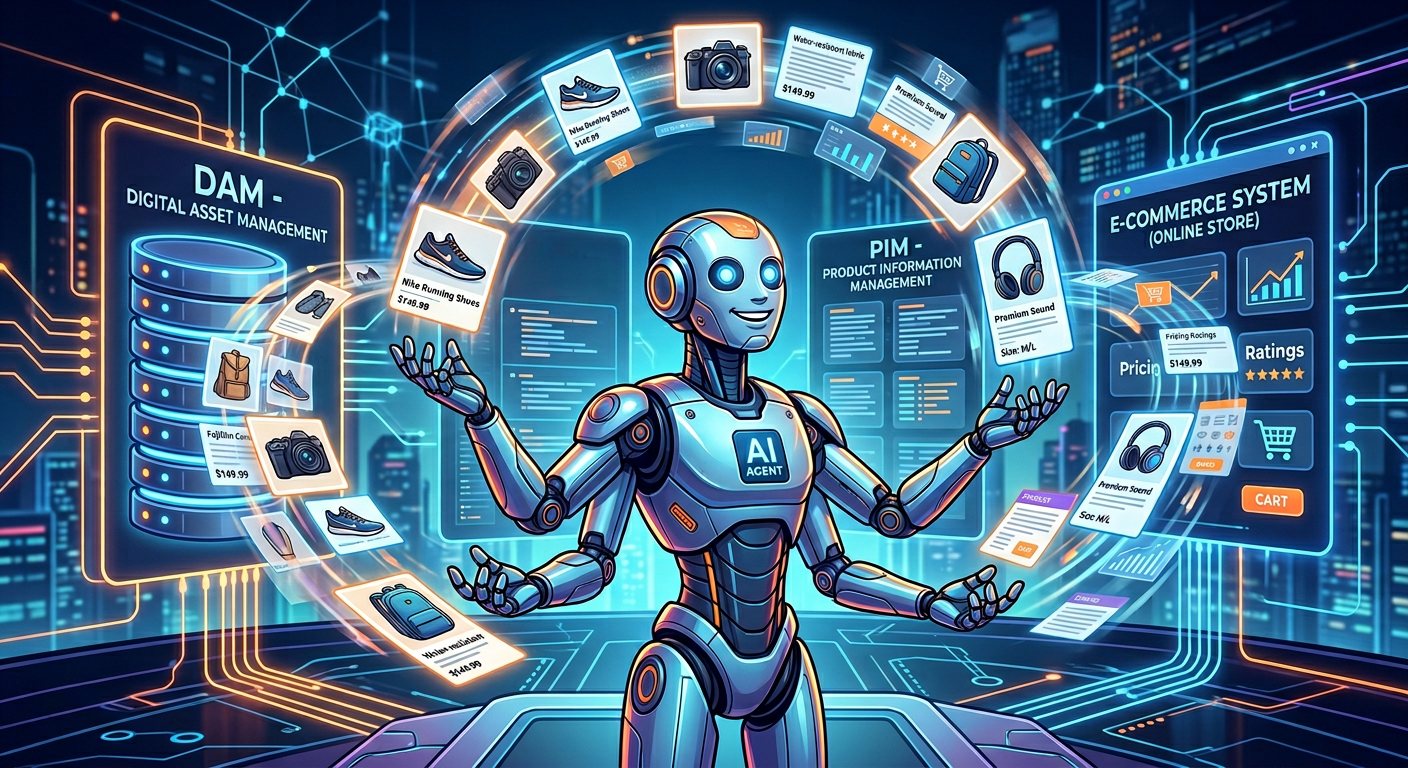

Der konkrete Bezug zu DAM wird besonders deutlich im Kontext von agentischem E-Commerce. Stellen Sie sich vor, Sie geben in ChatGPT oder Claude folgende Anweisung ein: „Kauf mir Nike Air Force One Sneakers in Weiß, Größe 44, unter 100 €, Lieferung bis Freitag.“

Ihr KI-Tool startet einen Agenten, der Online-Shops durchsucht, Angebote vergleicht, Authentizität bewertet und die Transaktion abschließt. Am Freitag kommt das Paket. 89 € werden von Ihrer Karte abgebucht.

Denken Sie darüber nach, was das für DAM bedeutet. In einem produktdatengetriebenen E-Commerce-Umfeld liefern PIM-Systeme strukturierte Produktdaten, und DAMs stellen dynamisch generierte, formatierte Assets mit passenden Metadaten bereit: SKU, Freigabestatus, Verfügbarkeit für einen bestimmten Ausgabekanal, Farbe, Größe und so weiter. Wenn ein Agent Produktangebote vergleicht, interessiert ihn das Design eines Webshops nicht. Die Stimmung eines Kampagnenbildes ist ihm egal. Es ist eine Maschine und sie bewertet Produkte nach einer klaren Abfolge: finden, vergleichen, entscheiden, Transaktion abschließen.

Der interessante Teil für uns sind die Vergleichs- und Entscheidungsschritte. Der Agent gleicht technische Produktdaten mit Asset-Metadaten über mehrere Dimensionen ab: Visuelle Inhaltsbeschreibungen (was ist abgebildet, aus welchem Blickwinkel, in welchem Kontext), Rechte- und Freigabedaten (genehmigte Kanäle, Märkte, Nutzungseinschränkungen, Ablaufdaten) sowie Lokalisierungsdaten (Sprache, Markt, Kanalzuordnung). Außerdem liest er Alt-Texte, eingebettete XMP/EXIF-Daten und C2PA-Content Credential-Signale und prüft, wie gut Asset-Beschreibungen mit Produktbeschreibungen übereinstimmen. Aus all dem baut der Agent einen Confidence Score. Wenn die Daten nicht zusammenpassen, wird das Produkt als potenziell unecht markiert und aus der Betrachtung ausgeschlossen.

Das verändert grundlegend, wofür ein DAM steht. In einer agentischen Welt wird es zur Vertrauensschicht, dem System, das sicherstellt, dass nur markenkonforme rechtlich freigegene und korrekt attributierte Assets in den Automatisierungsstrom gelangen. Damit das funktioniert, ist Datenqualität keine Haushaltsaufgabe. Sie ist ein unternehmerischer Imperativ. Drei Dinge folgen daraus:

Was Agenten sehen, wenn sie Ihre Marke betrachten. Für einen Agenten ist Ihre Marke nicht Ihr Logo oder Ihre Kampagnenbilder. Es ist die Vollständigkeit und Genauigkeit Ihrer strukturierten Produktdaten.

Der erste Kontaktpunkt ist keine Seite mehr — es ist ein Endpunkt. Agenten besuchen Ihre Website nicht. Sie sprechen mit einer API. Sie entdecken, vergleichen und kaufen — jede Entscheidung basiert ausschließlich auf Daten.

Das DAM als Wettbewerbsvorteil, nicht als Ablagesystem. In Metadatenqualität heute zu investieren ist keine Ordnungsaufgabe. Es ist eine strategische Entscheidung.

Die meisten DAMs können die erforderlichen Daten speichern. Die Frage ist, ob Unternehmen sie tatsächlich gepflegt haben — und ob sie für Agenten maschinenlesbar sind.

MCP: Eine neue Möglichkeit MarTech Systeme zu verbinden?

Wie macht man also ein DAM für KI-Agenten zugänglich, und warum löst dieselbe Antwort auch ein viel älteres Integrationsproblem?

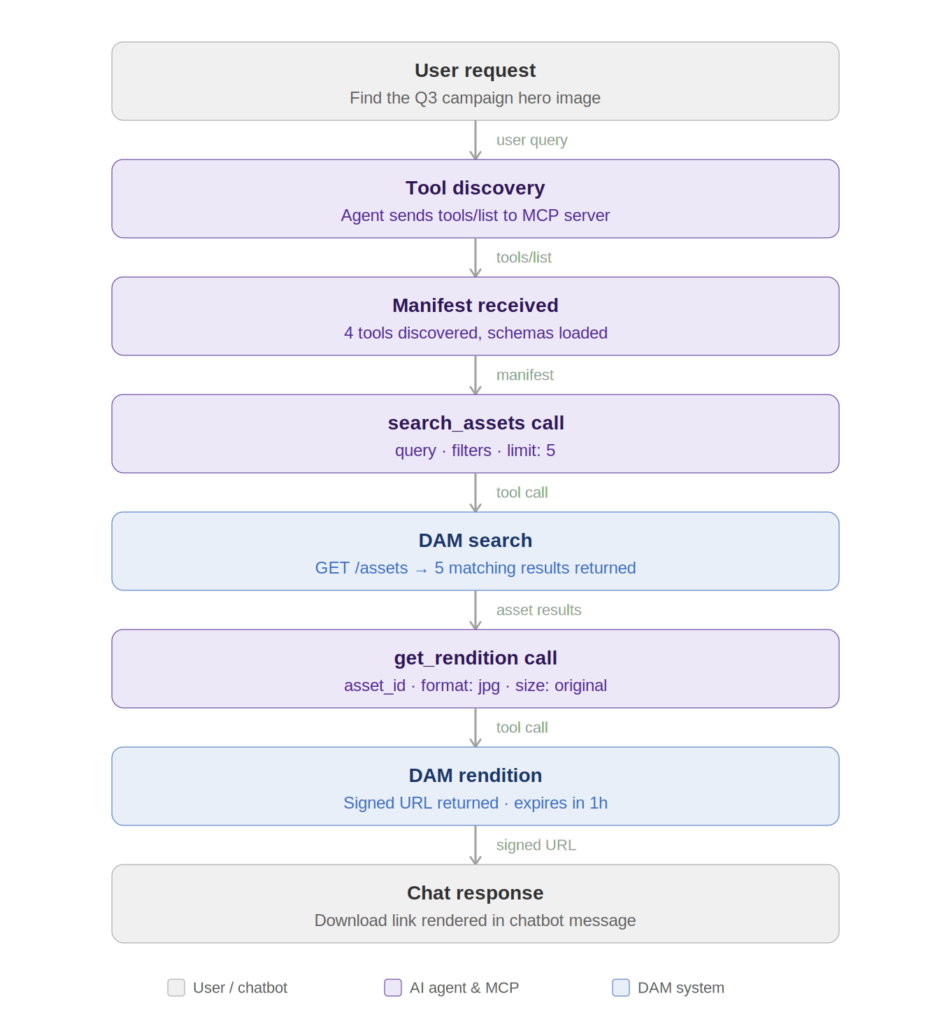

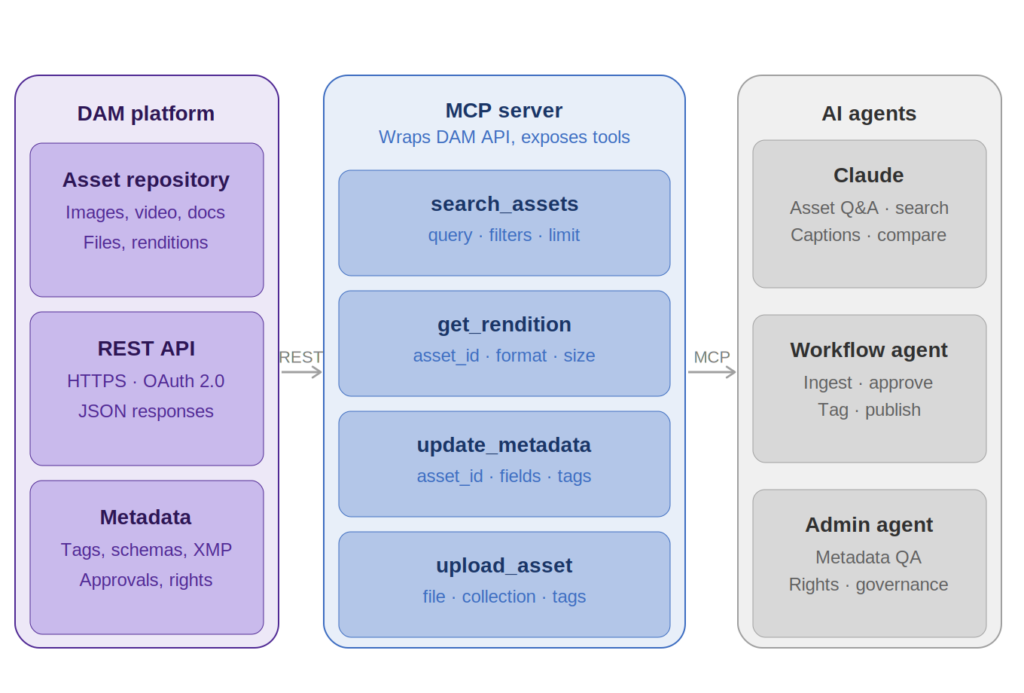

Die Antwort lautet MCP, das Model Context Protocol, ein von Anthropic entwickelter offener Standard. MCP bietet jedem System eine standardisierte Möglichkeit, seine Funktionen zu beschreiben, sodass KI-Agenten diese Fähigkeiten ohne benutzerdefinierten Code erkennen und aufrufen können. In seiner einfachsten Form hüllt ein DAM-Anbieter seine bestehende API in eine MCP-Schicht, macht ihre Endpunkte für KI-Agenten zugänglich und sorgt dafür, dass das System sofort mit jedem anderen MCP-kompatiblen Tool im Stack verbunden werden kann.

Sobald diese Schicht eingerichtet ist, können Sie über eine Eingabeaufforderung in einem externen KI-Tool auf Ihr DAM zugreifen und es verwalten. Sie könnten ChatGPT fragen:

„Erstelle mir Download-Links für alle freigegebenen Assets aus der Sommerkampagne 2026, konvertiere sie in ein für Instagram optimiertes Format und sende die Links an meine E-Mail-Adresse.“ Das funktioniert bereits. Ich habe Live-Demos von mehreren Anbietern gesehen.

MCP und die GUI: Eine Frage, die sich stellt

Das wirft eine Frage auf, die ich wirklich interessant finde und noch nicht abschließend beantworten kann: Ist ein Texteingabeprompt tatsächlich eine bessere Schnittstelle als eine grafische Benutzeroberfläche?

Was alles möglich ist, sobald das DAM für KI-Agenten zugänglich ist, ist wirklich beeindruckend, keine Frage. Aber eine gut gestaltete DAM-GUI mit facettierter Suche ist ebenfalls wahnsinnig effizient. Wenn man ein Filterfeld öffnet, sieht man die Metadatenwerte, die tatsächlich in der Bibliothek existieren. Man muss sich nicht merken, ob die Kampagne unter „Summer_26_EMEA“ oder „SS26 Campaign“ abgelegt ist. Man sieht die Optionen und klickt. Eine Texteingabeprompt verlagert diese kognitive Last zurück auf den User und bringt genau die Art von Mehrdeutigkeit, die eine gut gestaltete UI von vornherein ausschließt.

Für einen Standard DAM-User, der weiß, was er sucht, ist eine durchdachte GUI noch immer schwer zu schlagen. Bei Batch-Verarbeitung und automatisierten Workflows hat der agentische Ansatz klare Vorteile (siehe oben). Es ist durchaus möglich, dass KI-Chat-Schnittstellen irgendwann zur Standarschnittstelle zwischen Mensch und Maschine werden. Iin diesem Fall wäre ein per Prompt zugängliches DAM schlicht eine Grundvoraussetzung.

Aktuell haben beide Schnittstellen Ihre Berechtigung und für die meisten Unternehmen ist es in Zukunft wichtig ein DAM einzusetzen, das beide Möglichkeiten bietet.

MCP leistet weit mehr als promptgesteuerte Asset-Suchen

Jenseits der Schnittstellenfrage hat MCP eine gewichtigere Implikation: Es verändert grundlegend, wie Systeme miteinander integriert werden.

DAM-Integrationen waren schon immer eine Herausforderung. Jede Verbindung zu einem PIM, einem CMS oder einem Projektmanagement-Tool war historisch gesehen ein individuelles Projekt. Jemand muss zwei verschiedene APIs verstehen, Code schreiben, diesen anpassen und pflegen, um sicherzustellen, dass die Integration weiter funktioniert, auch wenn sich auf der einen oder anderen Seite etwas ändert.

Automatisierungs-Middleware, wie Make oder Zapier haben einen anderen Ansatz. Man kann Systeme visuell verknüpfen, ohne Code zu schreiben. Aber diese Tools arbeiten weiterhin über Punkt-zu-Punkt-Konnektoren, einen für jedes Anwendungspaar. Die Logik ist linear und statisch: Wenn X in System A passiert, tue Y in System B. Sie passt sich nicht an, sie denkt nicht, und wenn eine Plattform ihre API aktualisiert, kann der Konnektor brechen.

MCP ist ein entscheidender Schritt weiter. Statt bilateraler Verbindungen zwischen bestimmten Anwendungspaaren veröffentlicht jede Plattform einen einzigen MCP-Server, also eine standardisierte Beschreibung ihrer Fähigkeiten. Jedes MCP-kompatible System kann diese Tools entdecken und lesen und sofort verstehen, was die Plattform kann und wie sie aufzurufen ist. Ein DAM, ein PIM, ein CMS und ein Projekttool — jedes mit eigenem MCP-Server — werden ohne einen einzigen Punkt-zu-Punkt-Konnektor zwischen ihnen kombinierbar. Ein Agent verbindet sich mit allen vier, versteht, was jedes kann, und orchestriert dynamisch über sie hinweg. Neue Tools, die dem Stack hinzugefügt werden, sind sofort für jeden verbundenen Agenten verfügbar. Der größte Vorteil ist meiner Ansicht nach die Geschwindigkeit, mit der diese Integrationen bereitgestellt werden können. Man braucht noch immer Verständnis für Softwarearchitektur und muss die Anforderung idelaerweise aus usersicht verstehen, aber man kommt damit erstaunlich weit, ohne grosse Aufwände für die Entwicklung zu benötigen.

Theoretisch kann ein Agent freigegebene Assets aus dem DAM holen, sie den relevanten Produktdatensätzen im PIM zuordnen, die Daten an die E-Commerce-Plattform exportieren und den Aufgabenstatus in einem Projekttool aktualisieren — alles in einer einzigen geplanten Sequenz, ohne menschliche Beteiligung an jedem Übergabepunkt.

Natürlich gibt es Vorbehalte, die ich nicht verschweigen will.

Das Ausführen von Aufgaben über KI-Modelle ist auf Dauer kostspielig und verbraucht erhebliche natürliche Ressourcen.KI-Rechenzentren sollen 2030 zehnmal so viel Strom verbrauchen wie 2023. (Quelle: Energy and AI Report, IEA – International Energy Agency ) Und nicht alle MCP-Implementierungen sind gleich. Ein Anbieter, der eine Handvoll Read-Only Endpunkte als MCP-Tools bereitstellt, mag für eine Demo ausreichen, für produktive agentische Workflows ist das nicht genug. Es lohnt sich zu fragen, ob der Anbieter Leitplanken und Intelligenz rund um seine MCP-Tools implementiert hat, anstatt eingehende Agenten-Anfragen schlicht an die interne API weiterzuleiten. Und seien wir ehrlich…wir wissen noch nicht, ob diese Anwendungsfälle in der Praxis sicher und performant skalieren.

Was das für Ihre DAM-Strategie in 2026 bedeutet

Agentic readiness — fragen Sie Ihren DAM-Anbieter direkt nach seiner MCP-Roadmap. Wenn Sie Produkt-Assets für E-Commerce verwalten, ist das Thema ziemlich dringend. Die KI-Agenten, die losgeschickt werden um Produkte zu entdeckend und zu kaufen, werden saubere, strukturierte, maschinenlesbare Metadaten benötigen. Ihr DAM ist entweder bereit, sie zu bedienen — oder nicht.

Zu Integrationen — auch außerhalb des agentischen E-Commerce vereinfacht MCP die MarTech-Integration auf eine Weise, die es jetzt wert ist, ernst genommen zu werden. Behandeln Sie MCP-Support als Auswahlkriterium für ihr DAM System, nicht als Zukunftsüberlegung.

Zur GUI — Sie müssen sich nicht entscheiden. Eine starke Benutzeroberfläche für tägliche Nutzer und eine MCP-Schicht für automatisierte Workflows ergänzen sich — sie konkurrieren nicht.

Fazit

KI im DAM ist erwachsen geworden. Die experimentelle Phase liegt hinter uns. Was wir jetzt sehen, ist eine Verschiebung von ‚KI als angedocktes Feature‘ zu ‚KI als Teil der grundlegenden Infrastruktur‘, über die Assets verwaltet, kontrolliert und abgerufen werden.

Agentic E-Commerce ist wohl der grösste Treiber dieses Wandels. Man muss sich darüber im Klaren sein, dass KI-Agenten, nicht mehr nur Menschen zukünftig die Systeme sind, die auf Assets in Ihrem DAM zugreifen. Deswegen sind maschinenlesbare strukturierte Metadaten längst kein Nice-To-Have mehr, sondern essentiell um ein Unternehmen auch in Zukunft wettbewerbsfähig zu machen.

MCP wird dabei eine zentrale Rolle spielen. Das liegt jedoch nicht daran, dass ein Prompt-Feld eine DAM-Oberfläche ersetzen wird, sondern daran, dass es möglicherweise zum neuen Standard wird, über den KI-Agenten Content zwischen unterschiedlichen Martech-Systemen wie PIM, DAM, CMS und E-Commerce-Plattformen orchestrieren.

Die Unternehmen, die hier die Nase vorn haben werden, sind jene mit gut strukturierten Metadaten, gut gemanagten Libraries und DAM-Anbietern, die die Arbeit bereits getan haben. Jetzt ist ein guter Zeitpunkt herauszufinden, in welchem Lager Sie stehen.

Frequently Asked Questions

Welche Bedeutung hat agentische KI für Digital Asset Management?

Unter „Agentic AI“ versteht man autonome Softwareprozesse, die systemübergreifend agieren, ohne dass bei jedem Schritt menschlicher Input erforderlich ist. Für Digital Asset Management bedeutet dies, dass zunehmend KI-Agenten, und nicht nur menschliche User die Systeme durchsuchen und Assets sowie Metadaten anfordern. Ein DAM muss strukturiert, maschinenlesbar und über eine API zugänglich sein, um diese Anforderungen zu erfüllen.

Was ist MCP und warum ist es wichtig für DAM?

MCP (Model Context Protocol) ist ein von Anthropic entwickelter offener Standard, der jedem System eine standardisierte Möglichkeit bietet, seine Funktionen zu beschreiben, sodass KI-Agenten diese ohne benutzerdefinierten Code erkennen und aufrufen können. Bei DAM-Plattformen macht eine MCP-Schicht bestehende API-Endpunkte für KI-Agenten zugänglich und ermöglicht es, das System sofort mit jedem anderen MCP-kompatiblen Tool im MarTech-Stack zu verbinden, einschließlich PIM-, CMS- und Projektmanagement-Plattformen. DAM-Anbieter, die MCP implementiert haben, demonstrieren bereits Live-Workflows, in denen Agenten freigegebene Assets abrufen, konvertieren und ausleiten, ohne dass bei jedem Übergang menschliches Eingreifen erforderlich ist.

Welche Auswirkung hat agentic E-Commerce auf DAM und Produktdaten Assets?

Im agentischen E-Commerce entdeckt ein KI-Agent selbstständig Produkte, vergleicht Angebote und schließt Transaktionen ab, ohne dass ein Mensch eine Website durchsuchen muss. Bei der Bewertung von Produkten gleicht der Agent strukturierte Produktdaten mit den Metadaten der Assets ab, darunter visuelle Inhaltsbeschreibungen, Freigabestatus, Ablauf von Nutzungsrechten, Verfügbarkeit in den verschiedenen Kanälen und Lokalisierungsfelder. Assets mit unvollständigen oder unstrukturierten Metadaten werden als potenziell unecht markiert und aus der Auswahl ausgeschlossen. Für Marken, die ihre Produkt-Assets in einem DAM verwalten, bedeutet dies, dass schlampige Metadaten nicht mehr nur interne Ineffizienz verursachen, sondern auch Umsatz kosten.

Was sollten Unternehmen ihren DAM Hersteller in Bezug auf MCP fragen?

Fragen Sie nach, ob der Hersteller einen vollständigen MCP-Layer implementiert hat oder lediglich eine kleine Auswahl von Read-Only Endpunkten zu Demonstrationszwecken bereitstellt. Eine MCP-Implementierung sollte mindestens eine vollständige Enterprise Suchfunktion, Abfrage und Update wichtiger Metadatenfelder, Asset Downloads von Originalen und Renditions bereitstellen. Ausserdem sollten Sicherheits- und Logik-Gateways bzw. Ebenen hinsichtlich der Verarbeitung eingehender Agentenanfragen enthalten sein, anstatt Anfragen der KI-Agenten einfach direkt and die interne API weiterzuleiten. Für Unternehmen, die Produkt-Assets für E-Commerce verwalten, sollte heute MCP-Unterstützung als Auswahlkriterium mit hoher Priorität für ein DAM betrachtet werden.

Timo Faber

Timo Faber ist selbstständiger Berater für Digital Asset Management und Gründer von dampioneers mit Sitz in München. Mit über zwei Jahrzehnten Erfahrung in der DAM-Branche, unter anderem als Produktmanager bei Xinet, einem führenden DAM-Anbieter, der später von Northplains übernommen wurde, unterstützt er Unternehmen in der DACH-Region, in Europa und den USA bei der Auswahl, Implementierung, Integration und Optimierung von DAM-Systemen. Völlig herstellerunabhängig.