Dynamic Asset Delivery Services helfen dabei, die Ladezeit von Webshop-Seiten zu minimieren. Bilder und Videos werden nicht aus einem statischen Asset-Container abgerufen, sondern zum Zeitpunkt des Seitenladens dynamisch in der richtigen Größe, dem richtigen Farbraum, den richtigen Abmessungen und im richtigen Format generiert.

Websites, die mit dynamisch generierten Medieninhalten versorgt werden, haben daher einen erheblichen Vorteil gegenüber Websites mit statischen Asset-Links. In diesem Artikel erkläre ich, was diese Dynamic Asset Delivery-Lösungen sind, wie sie funktionieren und welche Vorteile sie bieten.

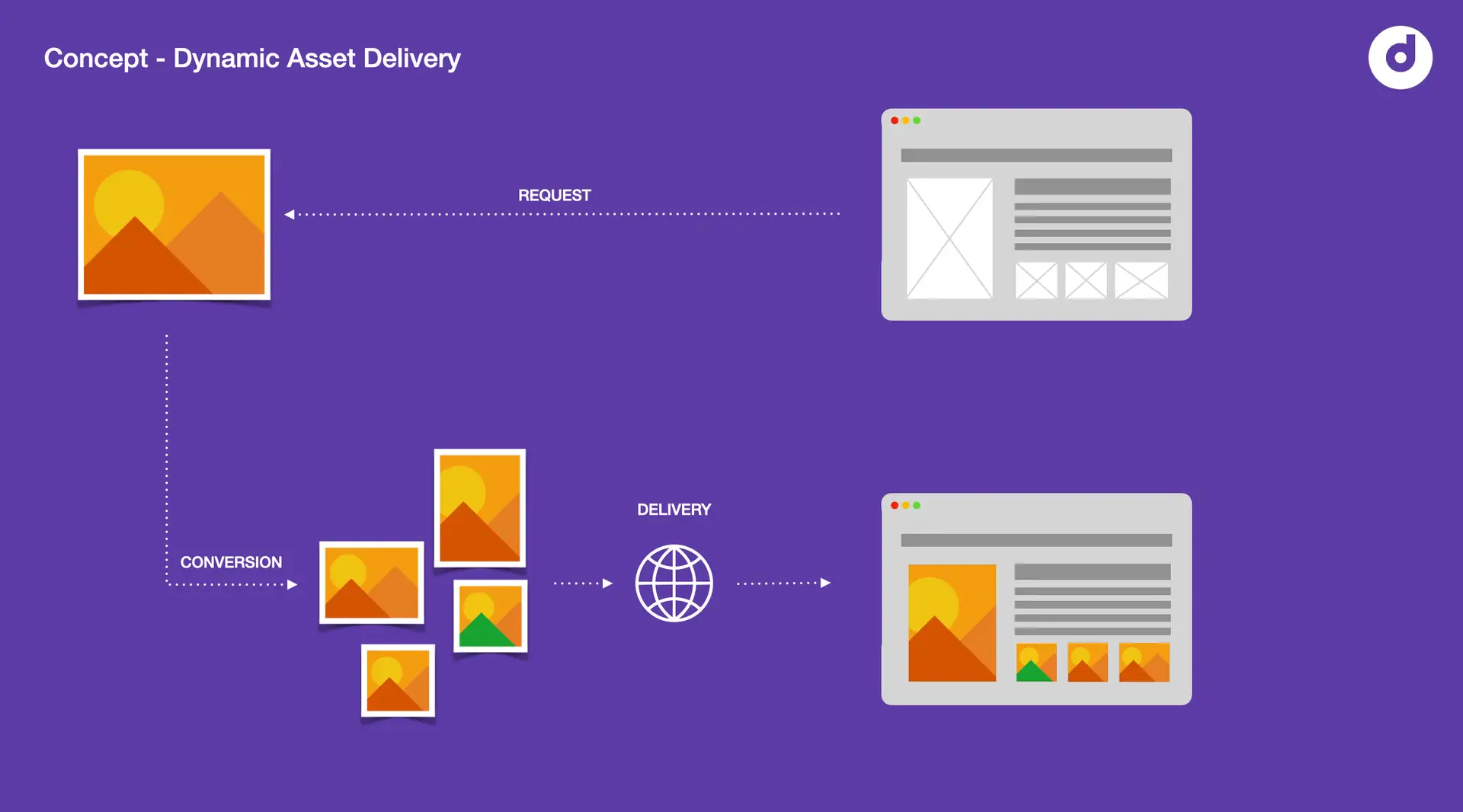

Wie funktioniert das?

Um ein Bild oder Video in einer optimierten Größe und einem optimierten Format anzuzeigen, wenn die Seite geladen und der HTML-Code vom Browser gerendert wird, müssen die Konvertierungsparameter an den Konvertierungsdienst übergeben werden. Der Konvertierungsdienst konvertiert dann die Bild- oder Videodatei entsprechend und liefert die konvertierten, optimierten Mediendateien über eine CDN-URL zurück an die anfordernde HTML-Seite. Alles in einem Schritt. Der Vorteil hierbei ist, dass die Konvertierung auf einen Backend-Konvertierungsserver ausgelagert und aus dem Webbrowser entfernt wird, der normalerweise mit der Darstellung des Bildes im richtigen Canvas beauftragt ist. Die Seite wird viel schneller geladen und die Benutzererfahrung ist viel besser.

Diese dynamischen Asset-Bereitstellungsdienste akzeptieren Konvertierungsparameter über HTTP-Anfragen oder URLs und wenden sie auf die Mediendatei in einem lokalen Datenspeicher an, was bedeutet, dass der Konvertierungsdienst in der Regel (obwohl es Ausnahmen gibt) Zugriff auf die Originaldatei haben muss. Folglich bedeutet dies auch, dass jedes Asset, das in einem DAM verwaltet wird, zuerst an den Konvertierungsdienst übertragen werden muss.

Sehen wir uns anhand eines einfachen Beispiels an, wie diese Konvertierungsparameter aussehen könnten. Bitte beachten Sie, dass die tatsächliche URL-API-Syntax und die Parameternamen in jeder Software einzigartig sind. Was ich hier zeige, sind lediglich Beispiele, und wenn es Ähnlichkeiten mit bestehenden realen Lösungen gibt, ist dies nur Zufall.

Angenommen, Sie fordern ein vorhandenes Bild mit einer Breite von 600 Pixeln an. So würde Ihre Anfrage aussehen. Vielleicht möchten Sie den Konvertierungsdienst bitten, Bilder mit einer Breite von weniger als 600 Pixeln zu vergrößern. Ich denke mir das jetzt aus, aber es könnte ein Schlüssel-Wert-Paar von scale=up-600 sein, was bedeutet, dass Bilder unter 600 px vergrößert werden sollen.

https://dynamic.delivery-platform.com/media/images/assetname.jpg?w=600&scale=up-600

Wir werden uns später noch weitere interessante Konvertierungsparameter ansehen, aber im Allgemeinen funktioniert es so. Einige Softwarelösungen für die dynamische Konvertierung von Assets oder die Bildoptimierung unterstützen auch die Konfiguration benannter Konvertierungssätze, sodass ein Verbraucher das „optimierte” Bild durch Übermittlung des Konvertierungssatznamens abrufen kann. Angenommen, das Hauptbild auf der Produktdetailseite Ihres Webshops muss 600 Pixel breit und 800 Pixel hoch sein, und wenn es sich um ein Querformatbild handelt, muss es zugeschnitten und als Hochformatbild mit einer Größe von 600 x 800 Pixel geliefert werden.

Man könnte ein Konvertierungsset erstellen und es „main-pdp” (Haupt-Produktdetailseite) nennen. Das Konvertierungsset mit dem Namen „main-pdp” würde mit den folgenden Parametern konfiguriert werden:

color: sRGB

width: 600px

height: 800px

scale: up-600

crop: fp

comp: auto

format: auto

Sie könnten dann das Bild mit der benannten Konvertierung anfordern, beispielsweise:

https://dynamic.delivery-platform.com/media/images/assetname.jpg?$main-pdp$

Diese API-Anfrage gibt das Bild zurück, das auf 600 x 800 Pixel zugeschnitten wurde, und zwar um den Fokuspunkt des Bildes herum, der individuell und manuell auf dem Bild festgelegt wurde. In neueren Versionen von Konvertierungsservern werden KI-Modelle verwendet, um den Hauptinteressenspunkt in einem Bild zu erkennen und es bei Bedarf um diesen Punkt herum zuzuschneiden.

Natürlich gehen die von dynamischen Medienplattformen angebotenen Konvertierungsparameter weit über die reine Anpassung der Bildabmessungen hinaus. Wenn Sie sich die API-Dokumentation der meisten Anbieter dynamischer Asset-Delivery-Plattformen ansehen, fallen Ihnen zwei Dinge auf. Erstens ist die API in der Regel sehr gut dokumentiert. Das macht Sinn, da sie die Hauptschnittstelle für diese Lösungen und das A und O für die typische Verwendung dieser Lösungen ist. Zweitens finden Sie eine wachsende Anzahl von API-Endpunkten, die Bildtransformationen in den folgenden Bereichen ermöglichen:

Farbraum

Dateiformat

Abmessungen

Zuschneiden, Füllen, Skalieren

Rahmenstile

Stileffekte

…und vieles mehr

Das Hauptziel bleibt jedoch weiterhin, Bilder so schnell wie möglich auf die Seite des Webbrowsers eines Benutzers zu laden, ohne dabei an Qualität einzubüßen. Denken Sie beispielsweise an die Schaufenster von Modegeschäften: Die Nutzer möchten Bilder in bester Qualität sehen, die sofort geladen werden. Hier kommen zwei Bereiche ins Spiel, die eine wichtige Rolle bei der dynamischen Bereitstellung von Medieninhalten für moderne E-Commerce-Websites spielen. Auto-Formate und Content Delivery Networks (CDNs) – beide werden wir in den folgenden Abschnitten näher betrachten.

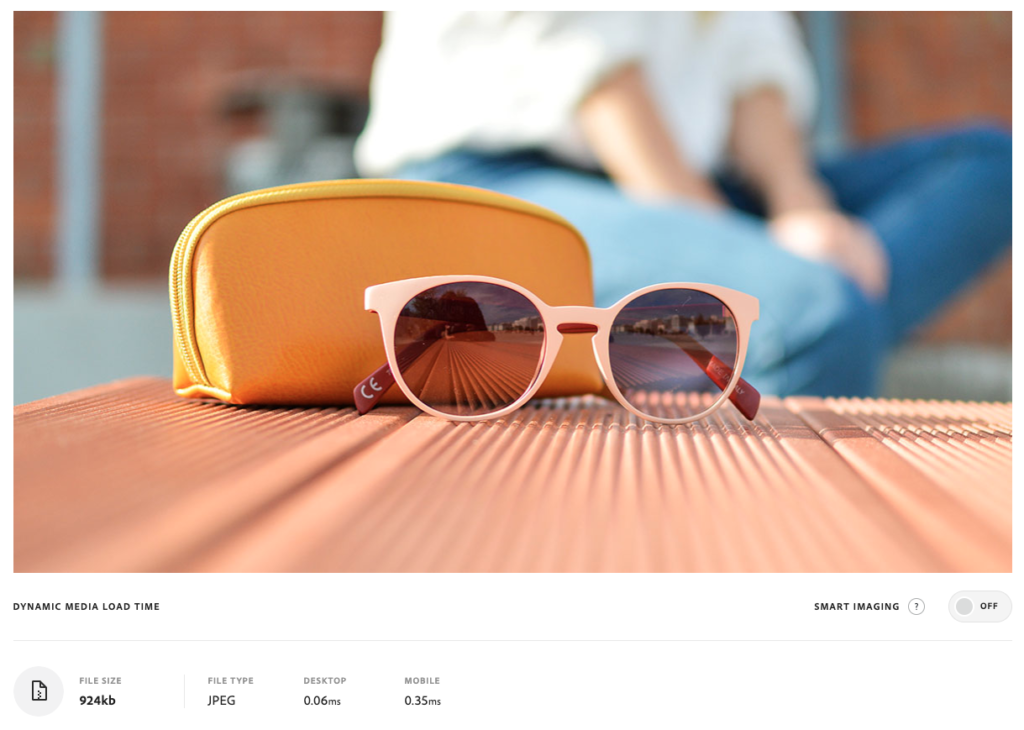

Komprimierung – kleinste Dateigröße bei größtmöglicher Detailgenauigkeit

Meistens werden Bilder im DAM-System in der höchstmöglichen Qualität gespeichert und verwaltet, um einen zu starken Verlust an Bildqualität zu vermeiden und sicherzustellen, dass Ausgabekanäle wie der Druck die erwartete Qualität liefern können. Wenn diese Bilder unverändert auf eine Webseite übertragen werden, ist das fast schon eine Katastrophe. Die Dateien sind riesig und die Übertragungsgeschwindigkeit auf der HTML-Seite ist sehr langsam.

In den meisten Fällen können Sie jedoch die Bildqualität erheblich reduzieren, ohne dass dies zu einer nennenswerten visuellen Beeinträchtigung führt. Genauso wie Sie die bestmögliche Bildqualität in Ihrem DAM als Master speichern sollten, sollten Sie den Verwendungszweck und die Zielgruppe Ihres Bildes berücksichtigen und die niedrigstmögliche Qualität verwenden, die für den Bildinhalt, die Zielgruppe und den Verwendungszweck akzeptabel ist.

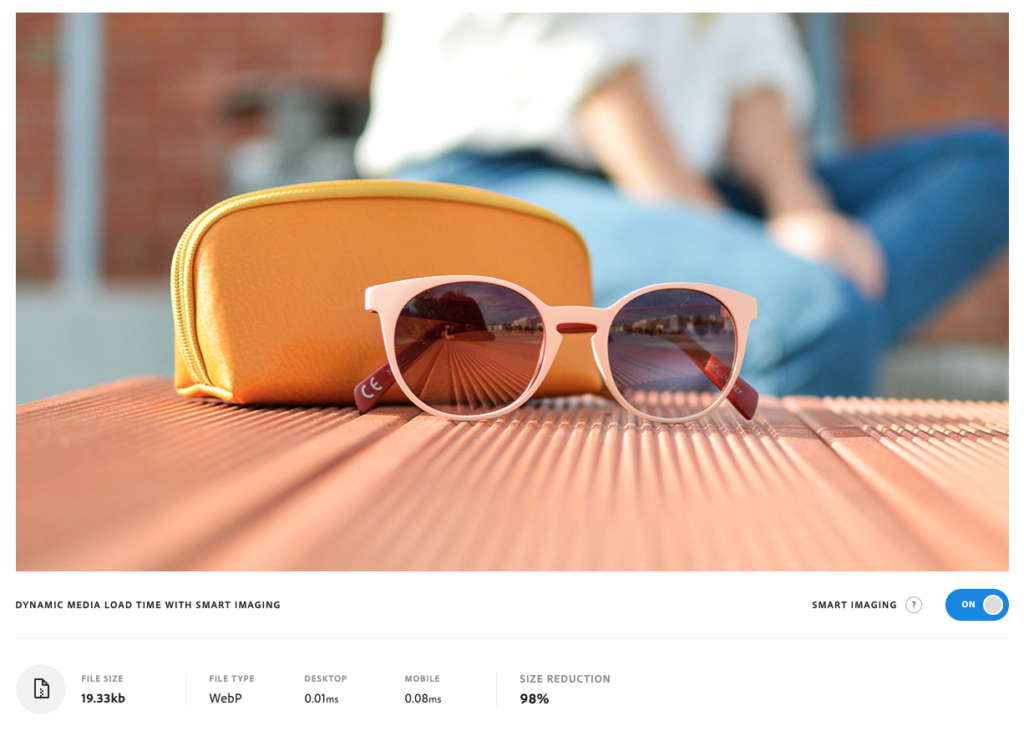

Es wird noch komplizierter, aber die Idee hinter dem oben Gesagten ist, so viel wie möglich darüber herauszufinden, woher die Anfrage kommt (Browser über User-Agent – verschiedene Browser unterstützen unterschiedliche Bildformate, Verbindungsgeschwindigkeit – je niedriger die Geschwindigkeit, desto kleiner die Ziel-Dateigröße usw.) und welche Auswirkungen dies auf das angeforderte Bild und seine Eigenschaften hat, wie z. B. Farbraum, Skalierungsparameter usw. Anschließend muss ermittelt werden, welches Format die beste Qualität und die kleinste Dateigröße für dieses bestimmte Bild liefert.

Eine Abfrage, die die Entscheidung über das Dateiformat und den Komprimierungsfaktor an den Konvertierungsdienst auslagert, könnte beispielsweise wie folgt aussehen:

https://dynamic.delivery-platform.com/media/images/assetname.jpg?w=600&h=800&c=scale&format=auto&compression=auto

Die meisten Bildoptimierungsdienste beginnen höchstwahrscheinlich mit der Auswahl eines modernen Bildformats wie WebP, AVIF oder HEIF. Diese Bildformate haben eines gemeinsam: hohe Komprimierungsfaktoren in Kombination mit hoher Bilddetailgenauigkeit, sodass es fast unmöglich ist, mit dem bloßen Auge einen Unterschied zwischen dem Original und einer komprimierten Version zu erkennen. Das Problem bei diesen neuen Formaten ist, dass sie nicht von allen Webbrowsern auf allen Plattformen gleichermaßen unterstützt werden. Bildoptimierungs- und Bereitstellungsplattformen kümmern sich auch darum und verwenden einen Fallback-Mechanismus, um das bestmögliche Bild (hohe Komprimierung, hohe Detailgenauigkeit) an den Browser des Benutzers zu senden.

In letzter Zeit werden KI-Modelle verwendet, um das Bild zu analysieren (den Bildinhalt zu lesen) und dann Bildbereiche, die weniger wichtig sind, stärker zu komprimieren und den Hauptinteressenspunkt im Bild weniger stark zu komprimieren.

Content Delivery Networks

Die meisten, wenn nicht sogar alle Dynamic Media Asset Delivery-Dienste nutzen ein Content Delivery Network als Teil ihres Angebots. Das ist so sinnvoll, dass ich mich nicht daran erinnern kann, jemals eine einzige Lösung ohne CDN-Angebot gesehen zu haben.

Im Internet gibt es viele Informationen über CDNs und ihre Funktionsweise, aber ich möchte dennoch kurz erklären, wie sie funktionieren und warum es für diese Softwareplattformen so sinnvoll ist, sie zu nutzen.

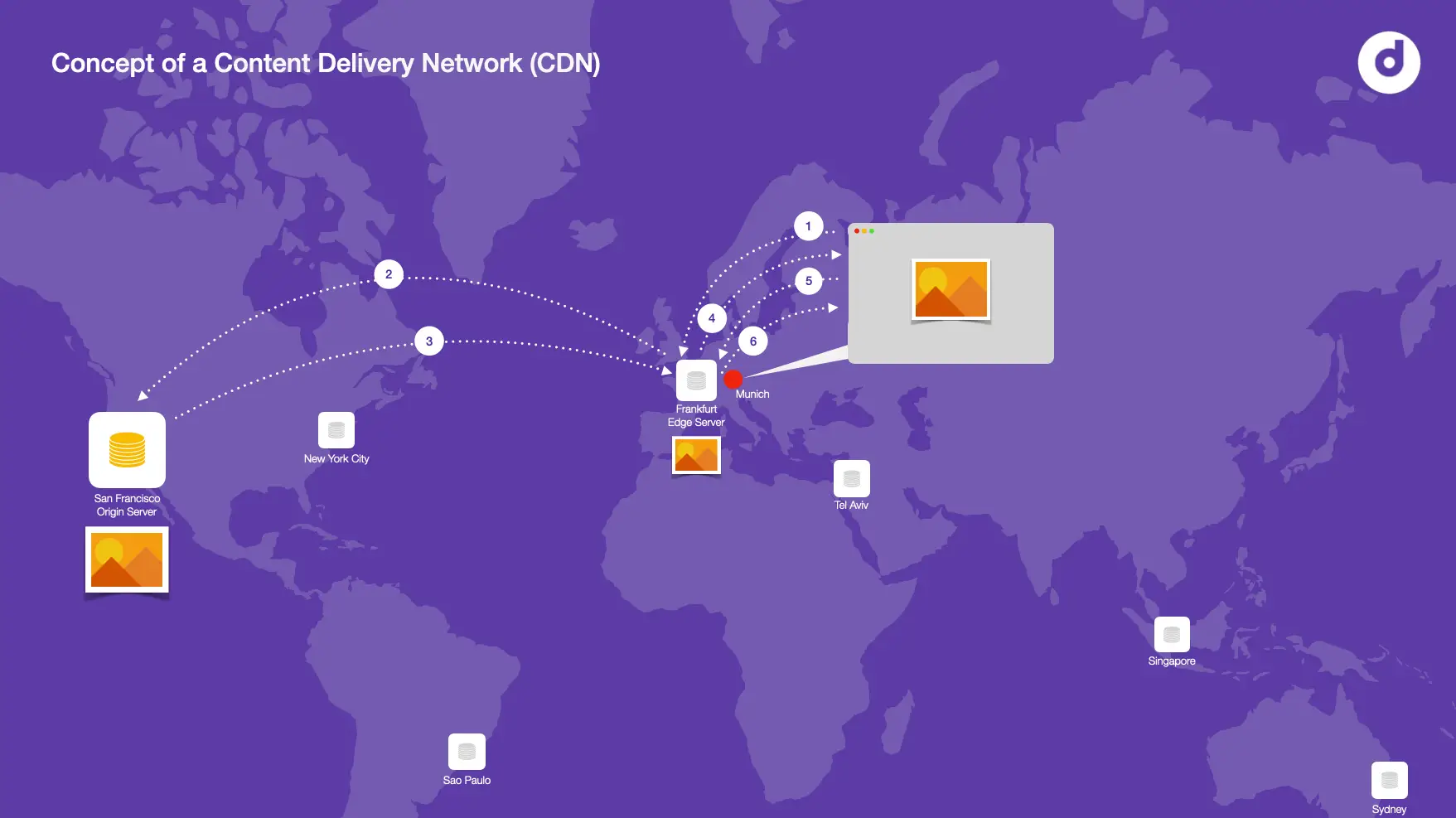

Ein Content Delivery Network (CDN) ist ein Netzwerk miteinander verbundener Server, das das Laden von Webseiten für datenintensive Anwendungen beschleunigt. CDN kann für Content Delivery Network oder Content Distribution Network stehen. Wenn ein Benutzer eine Website besucht, müssen die Daten vom Webserver der Website über das Internet zum Computer des Benutzers übertragen werden. Befindet sich der Benutzer weit entfernt vom Webserver, der die im Browser des Benutzers gerenderte HTML-Seite bereitstellt, dauert das Laden großer Dateien wie Videos oder Website-Bilder sehr lange. Stattdessen werden die Inhalte der Website auf CDN-Servern zwischengespeichert, die geografisch näher an den Benutzern liegen (diese werden als Edge-Server bezeichnet), und erreichen deren Computer viel schneller.

Die obige Abbildung zeigt das Grundkonzept, wie CDN eine schnelle Dateiverteilung über große Entfernungen gewährleistet. Sehen wir uns die Schritte 1 bis 5 einzeln an.

1. Ein Benutzer ruft zum ersten Mal eine Webseite auf. Der Webserver, der die HTML-Seite an den Browser des Benutzers liefert, findet einen img-Tag und lädt das Bild entsprechend von seiner CDN-URL.

2. Das CDN-Netzwerk überprüft, ob das Bild auf dem nächstgelegenen Edge-Server verfügbar ist. Möglicherweise ist es dort bereits zwischengespeichert. In unserem Beispiel wird die Anfrage von einem Nutzer in München initiiert, und das CDN-Netzwerk überprüft, ob das Bild in Frankfurt verfügbar ist, dem geografisch nächstgelegenen Edge-Server. Da es auf diesem Edge-Server nicht verfügbar ist, sucht das CDN das Bild auf dem Ursprungsserver.

3. Es findet das Bild auf dem Ursprungsserver, ruft es ab und überträgt es an den anfragenden Edge-Host.

4. Anschließend speichert es eine Kopie des angeforderten Bildes hier (erstellt einen Cache) und überträgt es an den anfragenden Client-Rechner.

5. Jetzt wird es interessant. Wenn der Benutzer das nächste Mal die Seite mit demselben Bild aufruft (und wir nehmen an, dass der Browser keine Kopie des Bildes mehr in seinem Cache hat), überprüft es, ob das Bild auf dem Edge-Server verfügbar ist, genau wie in Schritt (2), aber diesmal lautet die Antwort „Ja”. Das Bild kann auf den Knoten übertragen werden, der dem Initiator der Anfrage am nächsten liegt.

6. Diesmal überträgt der Server das Bild direkt aus seinem Cache (d. h. vom geografisch nächstgelegenen Edge-Server).

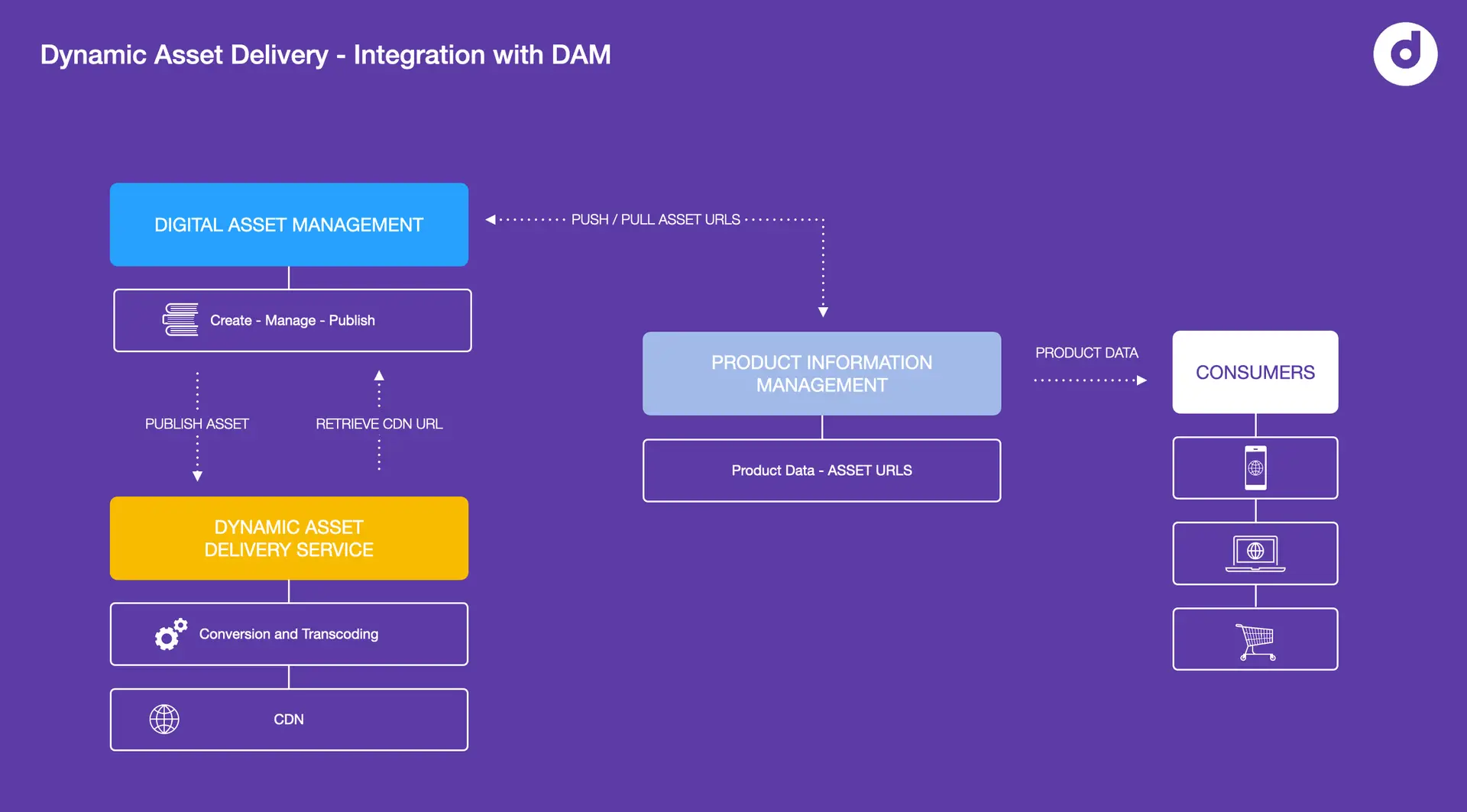

Typischen Integration mit DAM Systemen

In einem Unternehmensumfeld stehen DAM-Systeme stets im Mittelpunkt der Marketing-Technologie und alle Medienressourcen, die in den Output-Kanälen des Unternehmens verwendet werden, sei es Print, Social Media, Web, E-Commerce oder andere, sollten in einem zentralen Digital Asset Management-System verwaltet werden. Bilder oder Videos, die auf den digitalen Storefronts des Unternehmens veröffentlicht werden, stammen aus dem DAM, wo Katalogisierung, Zugriffsverwaltung, Zusammenarbeit und Veröffentlichung mit umfassenden Workflow-Automatisierungsdiensten verwaltet werden, die alle Assets während ihres gesamten Lebenszyklus im Unternehmen weiterleiten.

Wenn Assets für die Veröffentlichung im E-Commerce-System eines Unternehmens freigegeben werden, ist es nur logisch, dass sie vom DAM an nachgelagerte Verteilungssysteme übertragen werden.

Sobald das Asset veröffentlicht ist, wird es im Wesentlichen aus dem DAM-Datenspeicher in den Speichercontainer der Dynamic Media Delivery Platform übertragen. Die Übertragung erfolgt in der Regel über eine API. Der Asset-Konvertierungs- und -Bereitstellungsdienst nimmt das neue Asset auf, speichert es in seinem Speichercontainer und seiner Datenbank und wartet darauf, Transformationsanfragen über die URL-API anzunehmen.

Für das DAM-System ist es wichtig zu wissen, ob das Asset veröffentlicht wurde, wann es veröffentlicht wurde, wo es sich befindet und wie darauf zugegriffen werden kann. Aus diesem Grund wird die öffentliche CDM-URL in der Regel an das DAM zurückgesendet (erneut über API oder andere Methoden). Auf diese Weise kann das DAM-System von anderen Drittanbietersystemen abgefragt werden, um die öffentliche CDN-URL eines veröffentlichten Assets abzurufen. In dem in der Abbildung unten dargestellten Beispiel erhält das PIM-System die öffentliche URL eines Assets vom DAM, möglicherweise zu dem Zeitpunkt, zu dem ein Asset einem Produkt im PIM zugewiesen wird. Wenn das PIM-System nun den Produktkatalog im E-Commerce-System veröffentlicht, sind alle öffentlichen Bild-URLs sofort verfügbar. Je nach System und konfiguriertem Verhalten muss nun nur noch der Dynamic Delivery Service um ein Bild in der richtigen Größe und im richtigen Format „gebeten” werden.

Next-Gen Bildmanipulation mithilge von AI models

Angesichts der Geschwindigkeit, mit der künstliche Intelligenz und Deep-Learning-Modelle unsere Branche (und die Menschheit) beeinflussen, ist es nicht verwunderlich, dass die Manipulation von Bildern (im Sinne von „Bearbeiten von Inhalten“) nicht mehr nur Menschen vorbehalten ist, sondern in hohem Maße auch von Maschinen übernommen werden kann, die dabei oft die manuellen Bildbearbeitungsfähigkeiten des Menschen übertreffen.

Es wird viel darüber gesprochen, wie KI den DAM-Bereich revolutioniert, beispielsweise in den Bereichen automatisierte Tagging, verbesserte Suche, intelligente Inhaltsempfehlungen und Inhaltsmoderation. Ich persönlich glaube, dass angesichts des heutigen Entwicklungsstands die relevantesten Veränderungen im Bereich der Bildverarbeitung und der Verarbeitung natürlicher Sprache stattgefunden haben.

Die Bildverarbeitung ist ein Bereich der künstlichen Intelligenz, der tiefe neuronale Netze zur Analyse und Manipulation von Bild- und Videoinhalten nutzt. Viele der unten aufgeführten Funktionen sind nur dank der fantastischen Errungenschaften in Bereichen der Bildverarbeitung wie Objekterkennung, Objekterfassung und Segmentierung möglich.

Die Verarbeitung natürlicher Sprache im DAM-Bereich ist am relevantesten im Bereich der automatischen Untertitelung, der Sprach-zu-Text-Umwandlung und überschneidet sich mit dem Bereich der maschinellen Übersetzung, die es ermöglicht, Inhalte automatisch in verschiedenen Sprachen bereitzustellen. Sie dient auch als hervorragende Schnittstelle, um Anweisungen an die maschinelle Bildbearbeitung weiterzuleiten.

Schauen wir uns ein paar Beispiele an.

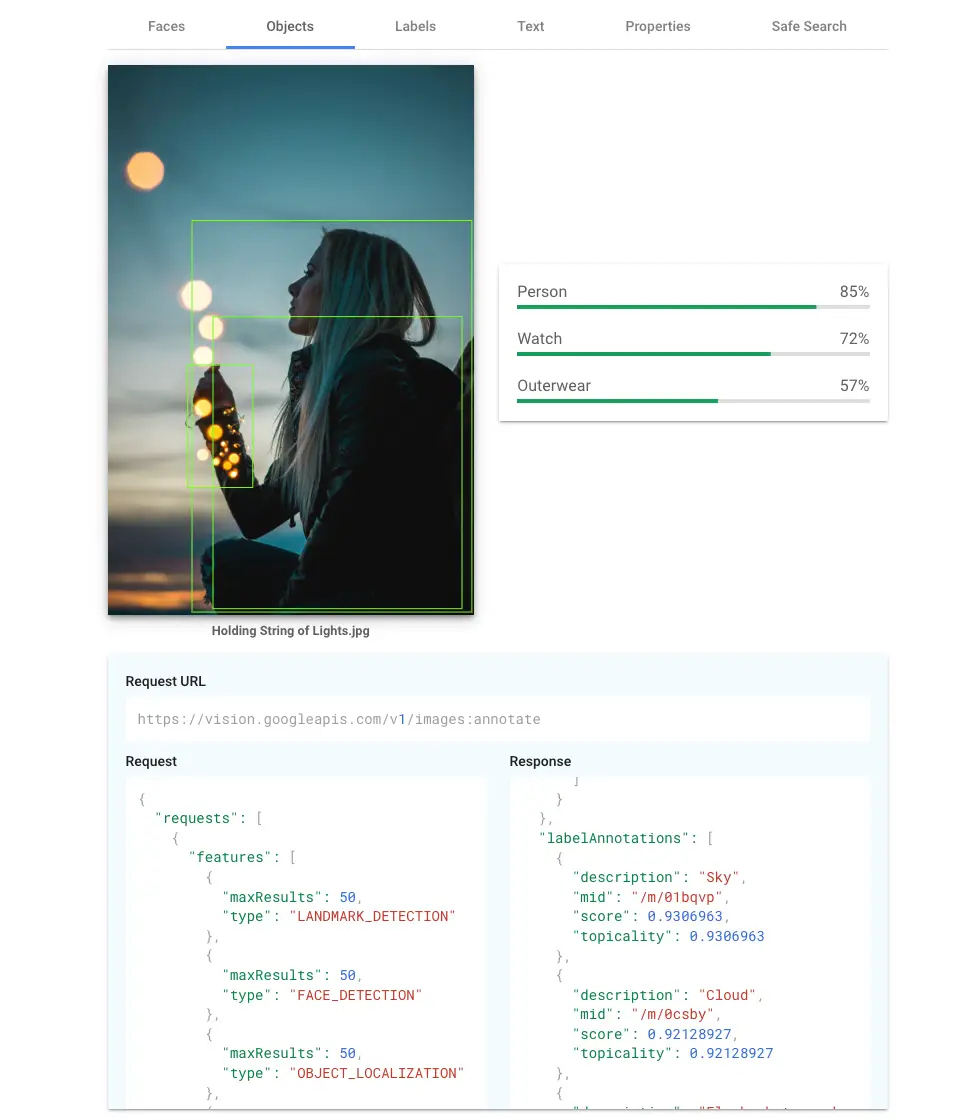

- Auto tagging

Das wahrscheinlich beliebteste ML-Modell für die Klassifizierung. Es analysiert automatisch den Bildinhalt, erkennt relevante Objekte einschließlich ihrer Position und weist ihnen Metadaten-Tags zu, um die Katalogisierung und Suche in einem DAM-Datenrepository zu erleichtern.

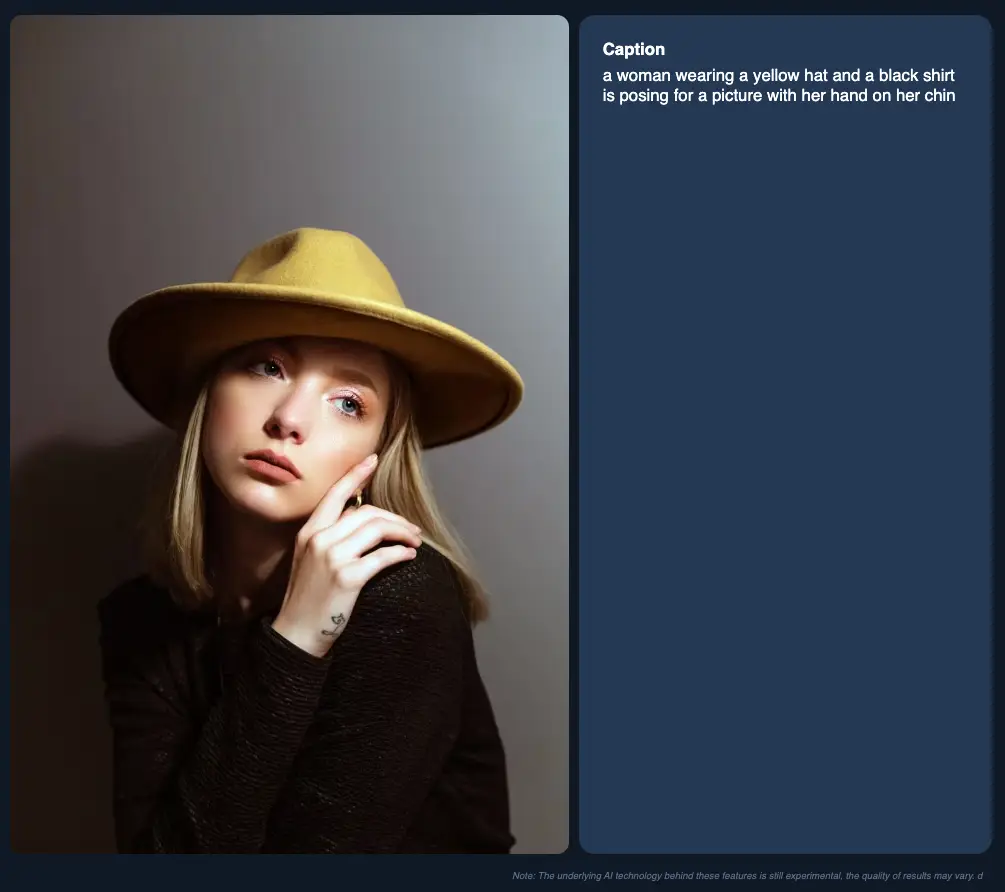

- Image captioning

Ähnlich wie beim automatischen Tagging liest dieses Modell den Inhalt eines Bildes, indem es alle relevanten Objekte darin erkennt. Anstatt eine Liste von Tags zu liefern, verwendet es Techniken der natürlichen Sprachverarbeitung, um einen vollständigen Satz zurückzugeben, der von einem Menschen verfasst worden sein könnte.

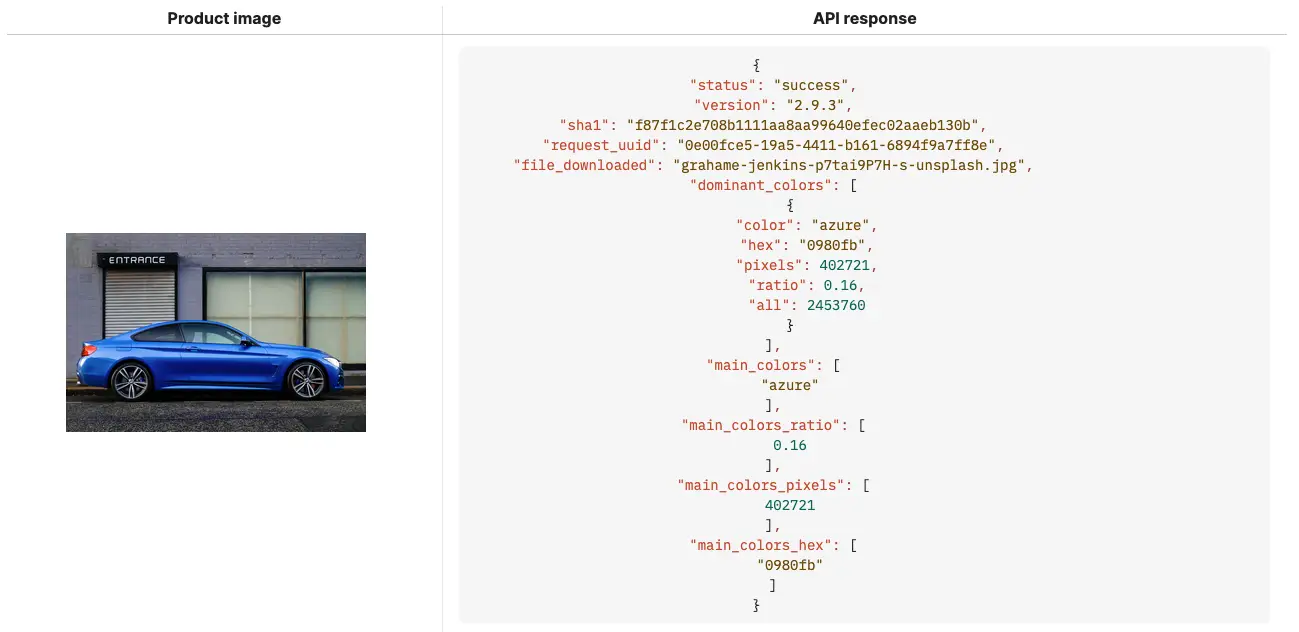

- Color palette extraction

Ähnlich wie bei der oben genannten Funktion könnte die Antwort, wenn ein API-Aufruf mit einer Anweisung zum Abrufen der auffälligsten Farben in einem Bild gesendet wird, eine Liste der am häufigsten verwendeten Farben sein, die in verschiedenen Farbräumen vorhanden sind und in sortierter Reihenfolge aufgelistet werden. Verbraucher profitieren beispielsweise von einer verbesserten Suche und Filterung (basierend auf Farben).

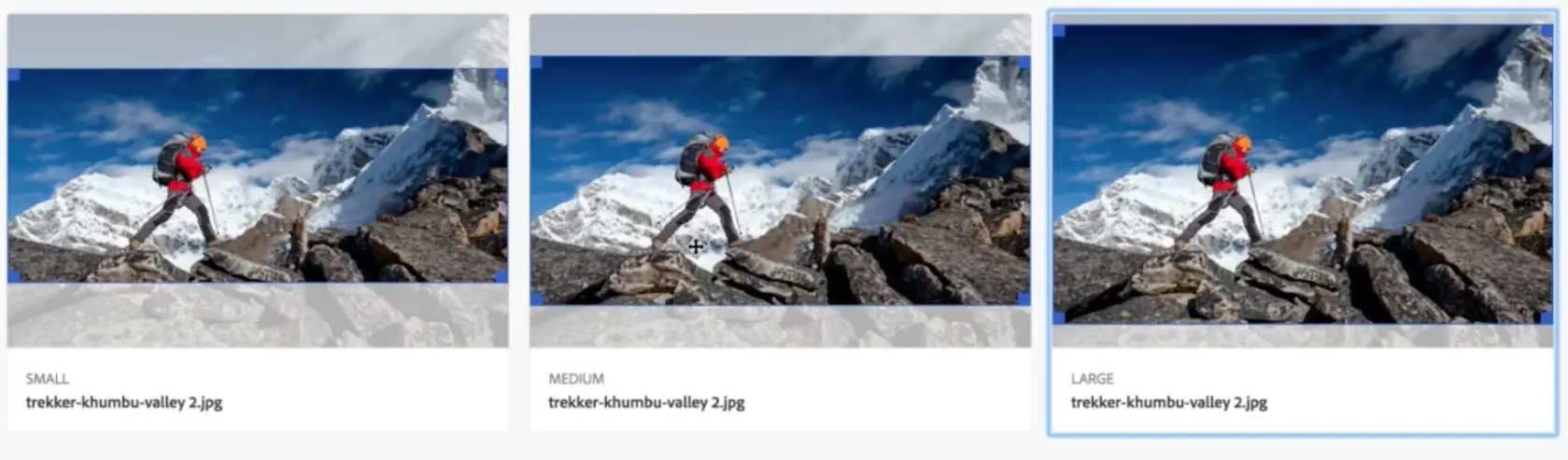

- Focal Point Cropping

Wenn Sie den Bildtransformationsdienst bitten, ein Bild auf eine bestimmte Breite und Höhe zuzuschneiden und diese Parameter als Pixelwert über die API anzugeben, müssen Sie der Engine irgendwie mitteilen, wo sie mit dem Zählen der Pixel beginnen soll, um die Zuschneidedimensionen festzulegen. Soll sie oben links, rechts, unten links usw. beginnen oder woanders? In vielen Fällen wissen Sie nicht einmal, wie das Bild aussieht, das Sie zuschneiden müssen. Hier kommt das Zuschneiden anhand des Fokuspunkts ins Spiel.

Sie geben entweder die x- und y-Koordinaten für den Fokuspunkt an (den Hauptbereich, der Sie auch nach dem Zuschneiden in der Mitte Ihres Bildes behalten möchten) oder ein KI-Modell, das anhand der Objekterkennung selbst erkennt, wo sich das Hauptobjekt im Bild befindet. In diesem Fall werden die Zielabmessungen um das von der KI erkannte Hauptobjekt herum angewendet.

- Face detection

Dies ist ein Sonderfall, der oft falsch verwendet oder missverstanden wird. Die Gesichtserkennung ist eine Unterklasse der Objekterkennung, wobei es sich bei den speziellen Objekten um menschliche Gesichter handelt. Die Gesichtserkennung ist jedoch etwas anderes. Dabei werden erkannte Gesichter in einem Bild oder Video mit einem Referenzgesicht verglichen und basierend auf dem Ergebnis (Übereinstimmung oder Nichtübereinstimmung) wird eine Aktion ausgeführt. Im einfachsten Fall wird das erkannte und identifizierte Gesicht mit einem Namensschild versehen.

Die Gesichtserkennung ist einfacher und dient ausschließlich dazu, bestimmte Objekte, d. h. Gesichter in einem Bild, zu erkennen und darauf basierend eine Aktion auszuführen. Ein Anwendungsfall könnte darin bestehen, das Bild entsprechend einer Reihe von Abmessungen zuzuschneiden, dabei jedoch die erkannten Gesichter unverändert zu lassen und um sie herum zuzuschneiden.

- Brand detection

Auch ein Sonderfall im Bereich der Objekterkennung. Hier geht es um die Erkennung von Markenlogos oder das Lesen von Markennamen mithilfe von OCR-Technologie. Durch die Identifizierung von Logos in nutzergenerierten Inhalten hilft diese Technologie bei der Überwachung der Marke, der Einhaltung von Markenrichtlinien und dem Schutz der Markenintegrität.

- Background Removal

Die automatische Hintergrundentfernung war und ist nach wie vor eine der beliebtesten Funktionen, zusammen mit der automatischen Keyword-Kennzeichnung, würde ich sagen.

Die Hintergrundentfernung nutzt eine Computer-Vision-Technik namens semantische Segmentierung. Im Vergleich zur Objekterkennung ist die Segmentierung ein Algorithmus, der Objekte in einem Bild pixelgenau mit scharfen Kanten identifiziert. Er nutzt mehrschichtige neuronale Netze (die mit einem umfangreichen Datensatz trainiert wurden, um alle Randfälle abzudecken), um jedes Pixel zu verarbeiten und es als Teil des Vordergrunds oder Hintergrunds zu klassifizieren.

Was diese Funktion so beliebt macht, ist ihr Anwendungsfall und die Tatsache, dass sie die Welt des E-Commerce revolutioniert hat.

Die automatische Umwandlung von beispielsweise Produktfotos in Assets mit transparentem Hintergrund in Sekundenschnelle macht das mühsame Hantieren mit Bildbearbeitungssoftware oder das Auslagern dieser Aufgabe an Fotoretuscheure überflüssig. Eine professionelle Hintergrundentfernung kann als ein Schritt in einem vollautomatisierten Prozess durchgeführt werden, was wertvolle Zeit und Ressourcen spart.

- Generative Fill

Als Adobe diese Funktion erstmals in einer neuen Version von Photoshop ankündigte, schien sie eine Revolution und ein Anwendungsfall für generative KI im realen Leben zu sein. Nur wenige Monate später begannen Bildoptimierungs- und dynamische Medien-Sasset-Plattformen, sie zu nutzen und stellten eine API-Schnittstelle zur Verfügung, um Pixel in einem Bild zu „erfinden“, die noch nicht existierten, aber Sinn ergaben, wenn man den Bildinhalt verstand.

Das funktioniert so, dass man eine Zielgröße für das neue Bild angibt und die Konvertierungs-Engine anweist, neue Pixel in den Bereichen zu generieren, die noch nicht existieren. Das könnte etwa so aussehen:

https://dynamic.delivery-platform.com/media/images/assetname.jpg?h=1200&fill=gen&format=auto&compression=auto

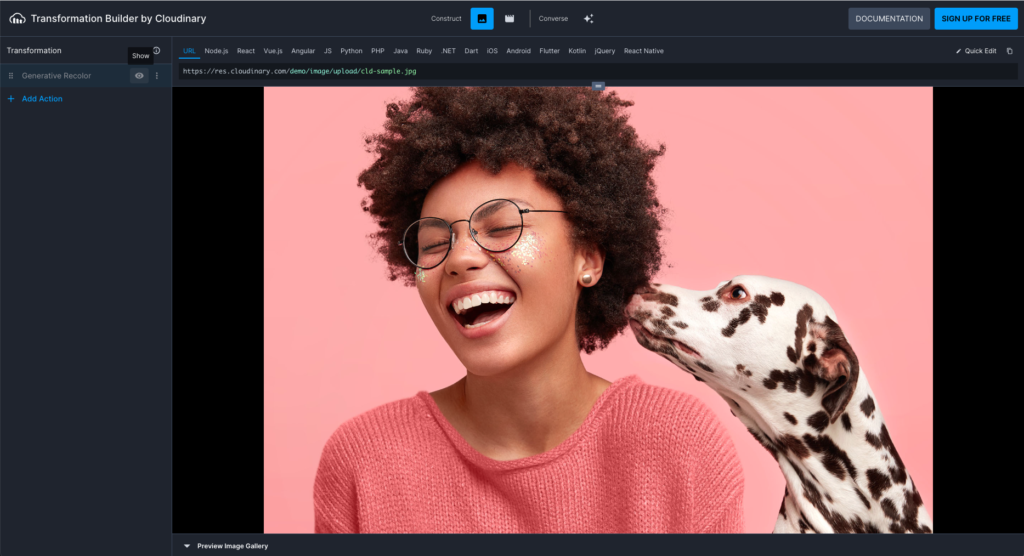

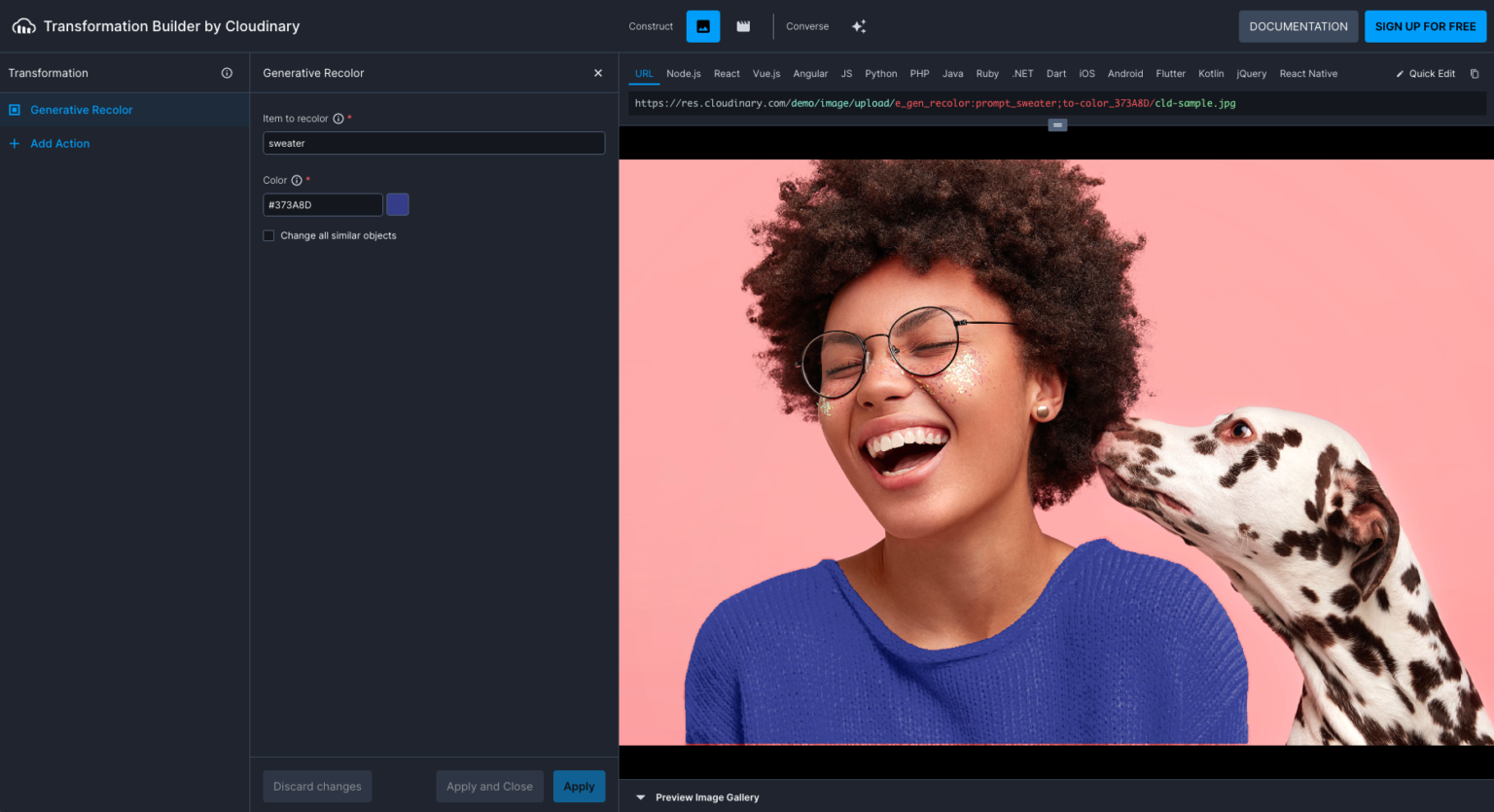

- Replace color

Was diese Funktion meiner Meinung nach wirklich herausragend macht, ist die Tatsache, dass man die Bearbeitungs-Engine anweisen kann, ein ganz bestimmtes Objekt im Bild durch menschliche Sprache neu einzufärben, z. B. „das T-Shirt“, „die Mütze“ usw. Die Engine versteht also menschliche Sprache mithilfe von NLP und kennt dank Segmentierung die genaue Pixelposition dieses Objekts.

Bei der Produktfotografie von Modeartikeln in großen Mengen könnte dies wertvolle Zeit sparen, da ein Artikel nur einmal am Model fotografiert werden muss und zusätzliche Farben automatisch mithilfe von Workflow-Automatisierung und KI-Bildbearbeitung generiert werden.

Der für das folgende Beispiel verwendete Befehl lautet:

https://dynamic.delivery-platform.com/media/images/assetname.jpg?e_gen_recolor:prompt_sweater;to-color_373A8D/

- Remove object, replace object

Zum jetzigen Zeitpunkt würde ich sagen, dass diese generativen KI-Modelle noch in der „Experimentierphase“ stecken. Es ist sehr beeindruckend zu sehen, was technisch auf Demo-Websites möglich ist, aber es ist auch sehr offensichtlich, was heute noch nicht funktioniert. Abgesehen von der technischen Machbarkeit, die beeindruckend ist, verstehen Sie mich nicht falsch, sehe ich ehrlich gesagt keine gute Anwendungsmöglichkeit für diese Modelle. Das Objekt, das entfernt oder ersetzt werden kann, ist für jedes einzelne Bild sehr spezifisch, weshalb ich mich frage, wie die Manipulationsflags automatisiert verwendet werden könnten.

Mit generativem Füllen kann ich mir beispielsweise vorstellen, dass alle Bilder, die aus einem DAM auf eine Dynamic Transformation-Plattform übertragen werden, in ihrer Größe geändert und in einem quadratischen Format auf die E-Commerce-Website übertragen werden könnten. In diesem Fall könnte eine Automatisierungspipeline so konfiguriert werden, dass sie je nach Eingabeformat (Quer- oder Hochformat) Bilder zuschneidet oder auffüllt und Bilder liefert, die um das Hauptmotiv des Bildes herum zugeschnitten sind (intelligentes Zuschneiden) oder mit Pixeln aufgefüllt sind, die sonst fehlen würden.

https://dynamic.delivery-platform.com/media/images/assetname.jpg?removeprompt:phone

Fazit

Diese dynamischen Asset-Bereitstellungsdienste bieten ein großes Potenzial, insbesondere für Transformationen unter Verwendung von KI-Modellen. Wenn man bedenkt, dass E-Commerce-Websites nach wie vor ein wachsender Vertriebskanal für digitale Assets (Bilder und Videos) sind, wird deutlich, dass auch der Bedarf an der Produktion digitaler Inhalte im Allgemeinen steigt. Was wir heute sehen, ist nur der Anfang, und jede Woche werden neue, leistungsfähigere und ressourceneffizientere KI-Modelle veröffentlicht. Ich habe daher keinen Zweifel daran, dass wir enorme Fortschritte bei neuen Technologien für die intelligente Bild- und Videotransformation erleben werden.

Ich bin fest davon überzeugt, dass die in diesem Artikel kurz beschriebene Technologie die Produktion großer Mengen von Inhalten für den E-Commerce revolutionieren wird.

Hier ist eine Liste von Lösungen für die dynamische Medienbereitstellung, mit denen ich entweder selbst in einem Kundenprojekt gearbeitet habe oder auf die ich bei meinen Recherchen gestoßen bin. Da einige der verwendeten KI-Modelle Open Source sind oder gegen eine Gebühr lizenziert werden können, gibt es unzählige Software-Dienste, die unten nicht aufgeführt sind.

Scaleflex

Cloudinary

TwicPics

Adobe

Amplience

Imgix

Als unabhängiger Berater habe ich keine Partnerschaftsverträge unterzeichnet und bin gegenüber keinem der oben genannten Unternehmen verpflichtet.